Vom 12. bis 15. Mai 2014 fand in Houston, Texas die diesjährige Microsoft TechEd North America statt. Dies ist die größte Konferenz zu Microsoft-Produkten, im Schwerpunkt im ITPro-Bereich. Dieses Jahr wurde die TechEd mit dem MMS (Microsoft Management-Summit) zusammengelegt.

(Abbildung: Die Keynote wird von einer lokalen Band eingeleitet, welche moderne Rock- und Pop-Songs auf klassischen Instrumenten interpretierte)

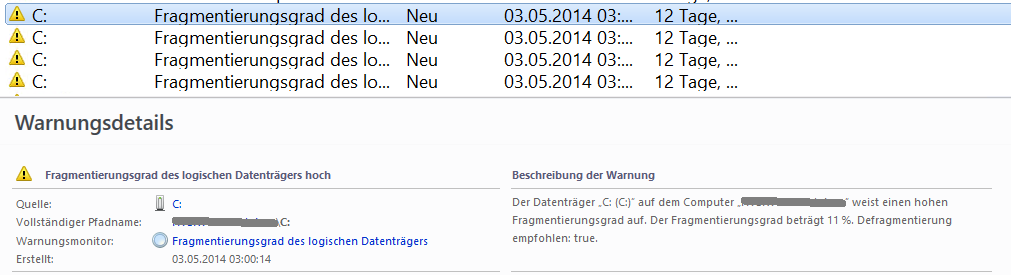

Die Keynote, gehalten von Corporate VP Brad Anderson, gab einen recht guten Überblick über Microsofts aktuelle Strategie – es geht massiv um die Themen “Cloud” (Azure) und “People Centric IT” (hier z.B. Themen wie “Bring your own device” (BYOD) und die Anbindung von Nicht-Microsoft-Systemen an Microsoft-Landschaften). Das Motto war “Mobile-first, cloud-first world”. Weiterhin wurden einige Neuerungen für Azure angekündigt bzw. an diesem Tag freigegeben (z.B. “Express Route”, “Azure Files”, “Azure Site Recovery”, VMs neuer Größe, …). Glücklicherweise konnte ich einen der letzten Plätze erreichen. Der Raum, der zur Verfügung stand, reichte gefühlt gerade für die Leute, die ihre Hotels im direkten Umfeld des Convention-Centers hatten und somit nicht auf die Shuttle-Busse angewiesen waren, die sich jeden Morgen durch den Stau quälen mussten.

(Abbildung: Microsoft Corporate Vice President Brad Anderson on-stage während der Keynote)

Es gab 6 Tracks zu den Themen

- “Data Plattform and Business Intelligence” (Datenbanken),

- “Datacenter and Infrastructure Management” (Windows Server, System Center, Virtualisierung, PowerShell),

- “Developer Plattform and Tools” (Entwickler),

- “Office Servers and Services” (Office, Office 365, Exchange, Lync, Sharepoint),

- “People-Centric IT” (Quer-Beet),

- “Windows, Phone and Devices” (Windows 8.1, Windows Phone, App-V)

Die ca. 12.000 Teilnehmer (Es gibt keine offiziellen Angaben, zahlen schwanken zwischen 11.000 und 13.000) verteilten sich erstaunlich gut über die ca. 400 verschiedenen Sessions, welche von den unterschiedlichsten Personengruppen (Microsoft Product-Manager, Microsoft Technical Evangelists, Microsoft Technical Fellows (Also Nicht-MS-Mitarbeiter, die sehr stark mit Microsoft-Themen verbunden sind), MVPs, Drittanbieter) gehalten wurden. Obwohl es ständig Schlangen gab, insbesondere beim Essen und an den Toiletten, hat man es dennoch geschafft, diese völlig ausverkaufte Veranstaltung logistisch ganz ordentlich abzuwickeln.

Parallel zu den Sessions gab es im Erdgeschoss ständig die Möglichkeit, sich auf der TechExpo mit verschiedenen Microsoft-Partner-Firmen über deren Produkte und Lösungen aus dem Microsoft-Umfeld zu unterhalten. Zusätzlich konnte man in Hands-On-Labs oder Instructure-Lead-Labs erste praktische Erfahrungen mit neueren Microsoft-Produkten zu sammeln. Weiterhin gab es die Möglichkeit, zu reduzierten Preisen Microsoft-Prüfungen für eine Zertifizierung abzulegen.

Ein Highlight waren aus meiner Sicht vor allem die Sessions der MVPs, die im Stil von “Lessions Learned” ihre Erfahrungen mit den aktuellsten Microsoft-Produkten aus dem Einsatz in größeren Szenarien weitergaben. Dieses Sessions waren stets gut besucht, vollgepackt mit Know-How und nicht zuletzt auch sehr unterhaltsam. Eine der Sessions (PCIT-B410) wurde von 5 MVPs gehalten (“How many MVPs does it take to get a Powerpoint started?” war nach ersten Startschwierigkeiten im Twitter zu lesen), Thema war der System Center Configuration Manager. Hier saßen ca. 1000 SCCM-Administratoren in einem Raum – eine unglaubliche Fülle von Wissen, ergänzt durch die Ausführungen der MVPs Kent Agerlund, Johan Arwidmark, Greg Ramsey, Jason Sandys und Steve Thompson.

(Abbildung: Die MVPs von PCIT-B410 hatten sichtlich Spaß!)

In einem weiteren Beitrag werde ich in naher Zukunft noch auf einige Inhalte eingehen, welche ich von der Konferenz “mitgenommen” habe.

Alle Sessions können unter http://channel9.msdn.com/Events/TechEd/NorthAmerica/2014?direction=asc#tab_sortBy_day als PPTX und MP4 heruntergeladen werden.

Zu Houston selber muss man leider sagen: Das ist keine Stadt, die man als Tourist gesehen haben muss. Abgesehen von den zum Teil extrem heißen Temperaturen gibt es nicht viel zu sehen. Außerhalb kann man das NASA Space Center besichtigen, in der Stadt selber gibt es einen recht hübschen Zoo und einige nette Museen. Ansonsten ist insbesondere am Abend und am Wochenende nichts los, die Texaner selbst raten einem, bei Dunkelheit nicht mehr auf die Straße zu gehen.

(Abbildung: Die Skyline von Downtown Houston, betrachtet aus Richtung Brown Convention Center)

Schreibe einen Kommentar...